Lors des négociations de l’Union européenne pour réguler l’IA, Paris a manœuvré afin de faire capoter les restrictions aux usages de cette technologie.

La Chronique, le magazine des droits humains / N°448

Écrit par Michel Despratx, illustrations issues du livre Intelligence artificelle : une (r)évolution, Ed Gallimard

Pour notre magazine La Chronique #448

Paru au mois de mars 2024

L’« IA Act » est le premier texte au monde réglementant les intelligences artificielles. Les négociateurs du Conseil de l’Union européenne1 et du Parlement européen l’ont achevé en décembre dernier. Un accord au forceps qui aurait pu permettre de réguler cette technologie en plein essor. Ceux qui voulaient protéger les citoyens des dangers des IA se sont en effet retrouvés face à des lobbyistes et à des représentants du gouvernement français, en ordre de bataille pour limiter les interdictions. Les partisans d’une IA la moins réglementée possible ont fini par obtenir que les militaires et les policiers conservent le droit d’utiliser des outils répressifs prohibés, comme les IA de reconnaissance faciale.

Le 9 novembre, un clash a eu lieu lors d’une réunion du Conseil européen. Ce jour-là, les négociateurs du gouvernement français ne lâchent rien. Ils s’opposent à toute règle contraignante visant les robots conversationnels, comme celui que développe la start-up française Mistral IA, en féroce concurrence avec l’américain ChatGPT. Pour les eurodéputés – plutôt favorables à une réglementation – qui négocient depuis des mois, l’intransigeance française est inacceptable, elle menace de faire capoter le texte. Ils quittent la négociation pour exprimer leur désaccord.

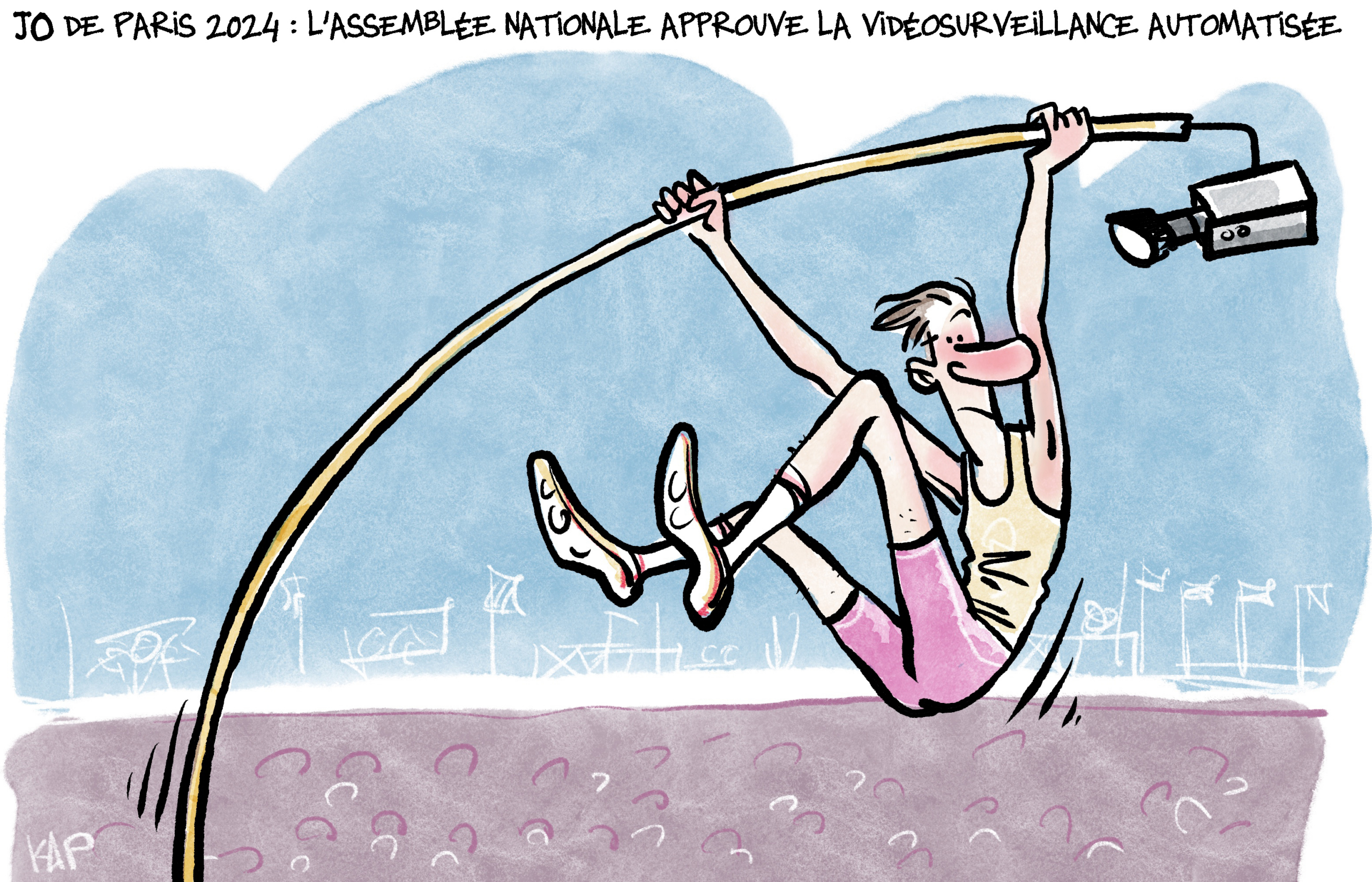

Ce n’est pas la première fois que Paris tourne le dos à l’Europe, au sujet de la réglementation de l’IA. Huit mois plus tôt, députés et sénateurs français votaient une loi autorisant la vidéosurveillance des Jeux olympiques de Paris à l’aide de systèmes d’IA. Pourtant, un courrier signé par 41 eurodéputés, le 17 mars 2023, leur rappelait que « le seul pays à avoir adopté la surveillance biométrique de masse de l’ensemble de sa population est jusqu’à présent l’autoritaire Chine ». Les Français n’ont rien écouté. Ils ont voté la vidéosurveillance algorithmique des JO, pour, affirmaient-ils, « assurer la sécurité des sportifs comme du public ».

La banalisation de la surveillance

Le ministre de l’Intérieur, Gérald Darmanin, promet maintenant un été parisien sécurisé grâce à l’IA : « Les caméras permettront aux forces de l’ordre de réagir rapidement en repérant des individus suspects. » Le décret d’application de la loi a précisé, en août dernier, les situations considérées comme « anormales » ou « présumant la commission d’infractions » : mouvement de foule, densité trop importante de personnes, voitures, ou badauds, à contresens… Noémie Levain, juriste à La Quadrature du Net, connaît le danger de cette sélection. Certaines populations la subiront plus que d’autres : « Le suivi des comportements focalise toujours sur des personnes qui passent le plus de temps en extérieur [SDF, musiciens, danseurs, jongleurs, marginaux…]. Il désigne comme suspects des individus qui ne commettent aucune infraction et certaines conduites, mais leur applique quand même un traitement policier. » Katia Roux, d’Amnesty International France, ajoute que ce regard policier permanent peut dissuader le citoyen d’exercer ses droits. « Quand on se sait surveillé, quand bien même on n’aurait rien à se reprocher, on n’agit pas de la même façon. On modifie son comportement. On peut renoncer à s’exprimer ou à rejoindre une manifestation ou un rassemblement. Un effet dissuasif qui peut donc conduire à l’autocensure. » Sans compter que l’on ignore si le gouvernement, une fois les JO finis, continuera de surveiller les citoyens en distinguant les comportements « normaux » et « anormaux ».

Les négociateurs français s’opposent À toute règle contraignante visant les robots conversationnels, comme celui que développe la start-up française Mistral IA

Cette banalisation des IA de surveillance, Emmanuel Macron y prépare le pays depuis sept ans. Dès qu’il arrive à l’Élysée, en 2017, il annonce vouloir « faire de la France un leader en IA ». Son ode à la « start-up nation » crée un appel d’air pour les géants de la tech qui développent des IA. Thales, Engie, IBM, Two-I, Idemia, Sensivic ou l’israélien BriefCam proposent aux villes françaises d’adopter leur technologie pour sécuriser les rues et les transports. Le maire de Nice, Christian Estrosi, les accueille à bras ouverts, il équipe une partie des 4 000 caméras de sa ville d’une IA qui reconnaît les visages. La Cnil juge l’outil illégal en 2019, et Nice achète à une société canadienne Avigilon, un logiciel qui traque les personnes selon leur apparence (âge, taille, port de barbe, abaya2 ou bonnet). Selon Henri Busquet, de la Ligue des droits de l’Homme, Avigilon pourrait « permettre de suivre les trajets d’un opposant dans la ville ». La mairie de Nice refuse de confirmer à La Chronique si elle utilise ce logiciel aujourd’hui. Il n’y a pas qu’à Nice, la ville aux 4 000 caméras, que des IA surveillent les citoyens au détriment des libertés publiques.

Normaliser les comportements

À Rouen, la mairie a installé dans un bus de nuit la dernière invention en la matière. Un petit boîtier blanc, vissé au plafond du bus, capte « les agressions verbales. Les sons des passagers qui traduisent un énervement, une colère ou un comportement agressif », dixit la start-up Sensivic qui le fabrique. Une fréquence hertzienne monte dans les aigus, une tonalité s’envole, un rythme syllabique accélère ? Une caméra s’allume, un policier municipal examine les images et décide d’envoyer ou non une patrouille. Myriam Mulot, vice-présidente de la métropole Rouen-Normandie, nous vante au téléphone un « capteur d’incivilités [qui] incite davantage de femmes à prendre le bus la nuit ». Selon elle, il déclenche à peu près cinq alertes par semaine. Toutes liées à de réelles agressions ? Non. « On a connu cinq fausses alertes, avec des cris d’enfants ou deux personnes qui s’appellent dans le bus. » Sensivic en avoue une autre : « une équipe chargée du ménage avait chahuté sous le détecteur ». Aux yeux de La Quadrature du Net, ces IA de surveillance « nourrissent le rêve de plus en plus d’élus à la tête de nos villes, d’administrer des quartiers sans bruits anormaux ou trop forts, débarrassés de toutes les extravagances humaines ». Et d’où seraient exclus, en somme, les comportements qui dévient de la norme et les personnes jugées indésirables. Les ONG des droits humains ne sont pas les seules à se méfier de cette IA qui surveille les phrasés. La Cnil a signalé, en 2019, que des capteurs sonores pourraient servir à écouter des conversations révélant « des opinions politiques, des convictions religieuses, l’orientation sexuelle ou la santé ». Le ministère de l’Intérieur, de son côté, les encourage : il a sélectionné les capteurs de sons de Sensivic pour sécuriser les JO de cet été.

Le 14 juin 2023, le président Macron entre au salon VivaTech, porte de Versailles. À ce rendez-vous européen des start-up de la tech, il annonce au micro que l’IA va conquérir, sous peu, un nouveau territoire. « Sur l’immigration, nous avons un problème de traitement des données. Utilisons les IA pour être plus efficaces ! » « Plus efficaces », mais dans quel sens ? Pour décider plus vite, mieux qu’un humain, du sort d’une personne migrante ? Si elle mérite un asile ou une expulsion du territoire ? Le ministère de l’Intérieur ne répond pas à cette question, posée par La Chronique. Mais, en septembre, Le Canard enchaîné révèle qu’un de ses fonctionnaires s’est aidé d’une IA pour refuser un visa à une femme afghane. Le journaliste a eu la bonne idée de tester cette IA en ligne. Verdict ? Dangereusement défaillante : elle est capable « d’adapter ses réponses à l’historique des recherches de l’ordinateur qui l’interroge ». Aurel, un dessinateur du journal, a imaginé la scène. Dans un bureau du ministère, un fonctionnaire visiblement déçu tend un papier à sa collègue : « L’IA autorise le visa… » La femme : « Ça devait être un ordinateur de gauche… Essayez sur le mien. »

1— Représentants des gouvernements des États membres.

2— Vêtement couvrant le corps, venu du golfe Persique.